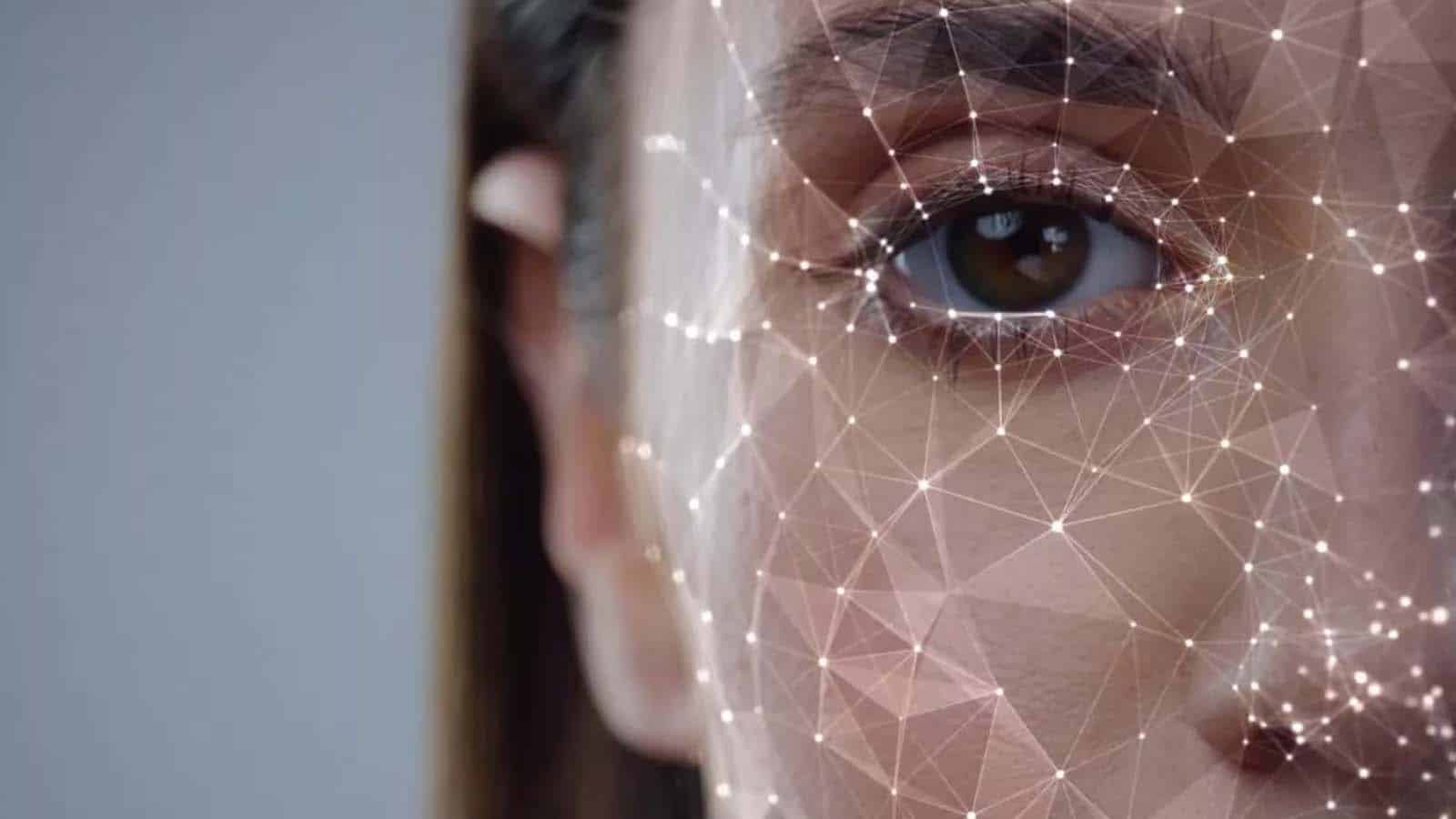

La crescente minaccia dei Deepfake sta spingendo un gruppo di oltre 400 esperti di tecnologia a sollecitare i Governi mondiali a intervenire con leggi più stringenti per fermare la diffusione di queste rappresentazioni realistiche create attraverso algoritmi di intelligenza artificiale. La lettera, intitolata “Disrupting the Deepfake Supply Chain“, mira a mettere in evidenza l’urgenza di affrontare il problema, affermando che i Deepfake costituiscono una minaccia significativa per l’umanità e stanno già causando danni a individui e democrazia.

L’emergenza globale delle false realtà audiovisive

Andrew Critch, ricercatore di IA presso l’Università della California, Berkeley, sottolinea la necessità di imporre obblighi nella programmazione legislativa per affrontare questa sfida. Il dibattito sui Deepfake è particolarmente acceso negli Stati Uniti, dove immagini manipolate di personaggi famosi, come la pop star Taylor Swift, hanno sollevato preoccupazioni significative. I legislatori statunitensi stanno già considerando la possibilità di criminalizzare la produzione di Deepfake dannosi.

I Deepfake comprendono rappresentazioni realistici in forma di immagini, audio e video, generati da algoritmi avanzati che li rendono sempre più difficili da distinguere dal contenuto creato da esseri umani. La lettera propone raccomandazioni specifiche per regolamentare i Deepfake, tra cui la completa criminalizzazione della pornografia infantile realizzata tramite questa tecnologia, con sanzioni penali per chiunque sia coinvolto nella creazione o diffusione di contenuti dannosi. Inoltre, le aziende di IA sono sollecitate ad implementare misure preventive contro la creazione di questo tipo di contenuti dannosi.

Tra i firmatari della lettera si trovano personalità di rilievo nel mondo accademico, dell’intrattenimento e della ricerca, come Steven Pinker e Yoshua Bengio. Questo sottolinea la preoccupazione condivisa a livello globale riguardo alla necessità di affrontare il problema dei Deepfake.

Legiferare contro il danno

La sfida di regolamentare e gestire l’impatto sociale dei sistemi di intelligenza artificiale è stata una priorità per i regolatori, soprattutto con l’avanzamento delle tecnologie generative. Le recenti innovazioni, come il modello IA Sora di OpenAI, che crea video credibili da prompt testuali, sollevano ulteriori interrogativi sulla necessità di un controllo più rigoroso.

La lettera rappresenta un richiamo urgente alla responsabilità legislativa e tecnologica, evidenziando la necessità di un approccio globale per affrontare la minaccia crescente dei Deepfake, proteggendo così la società e preservando l’integrità dell’informazione e della comunicazione.